Septembre dernier, à l'approche des législatives slovaques, un enregistrement suspect fait trembler le monde virtuel. Une conversation entre Michal Simecka, figure de l’opposition, et un journaliste, évoquant corruption et fraude électorale, circule. Simecka assure : “Personne ne pourra vous accuser de corruption”. Le journaliste, prudent, l'interrompt : “Prudence, ne mentionnez pas cela ouvertement.” Cette pièce audio est pourtant une fabrication, un canular élaboré par l'intelligence artificielle, dévoilent des vérificateurs de faits. Des indices comme une élocution artificielle et des pauses inhabituelles ont éveillé leurs soupçons. Diffusé massivement pendant la période de silence électoral, ce faux enregistrement met Simecka et ses alliés dans l'embarras. Malgré les démentis de Simecka et les mises en garde de la police slovaque contre la désinformation en ligne, c'est son adversaire, Robert Fico, qui remporte les élections.

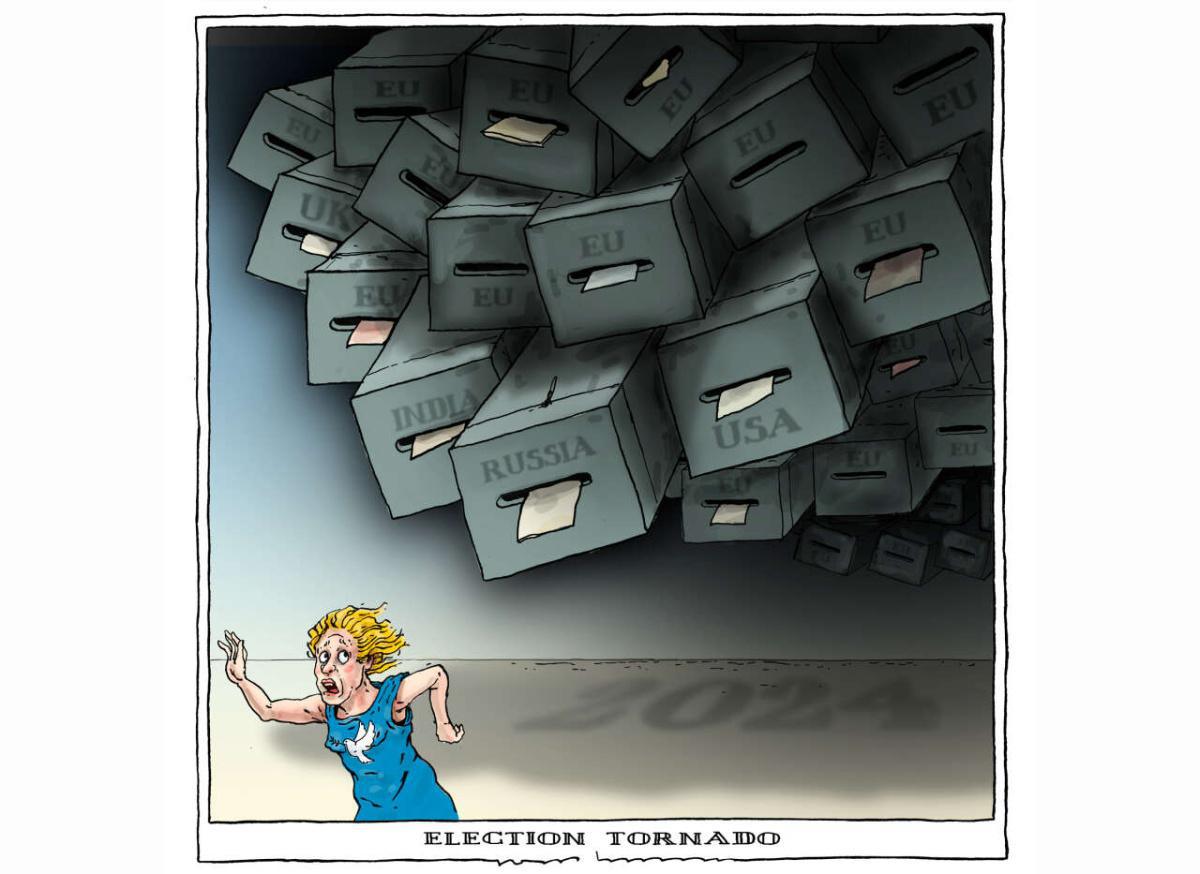

Cette affaire marque une nouvelle ère dans la guerre de l'information. Les réseaux sociaux, au cœur de ce maelström, font face à un défi colossal. En 2024, près de la moitié de la population adulte mondiale, soit 2 milliards d’individus, sont appelés aux urnes. La désinformation en ligne, déjà présente lors des précédents scrutins, se renforce par les avancées fulgurantes de l’IA, comme le démontrent des outils tels que ChatGPT (OpenAI) ou Midjourney. Ces technologies facilitent la manipulation des contenus numériques et rendent leur identification de plus en plus ardue. Les deepfakes, déjà utilisés dans les conflits Israël-Hamas et Russie-Ukraine, menacent désormais les élections mondiales.

Face à cette menace, les autorités sonnent l'alarme. Au Royaume-Uni, le GCHQ alerte sur des "bots hyperréalistes" et des campagnes de deepfakes sophistiquées pour les législatives de 2024. Aux États-Unis, des sénateurs bipartisans suggèrent d'interdire les contenus trompeurs générés par l'IA dans les communications politiques. Les plateformes sociales, telles que Facebook, YouTube, TikTok, et d'autres, sont sous pression pour lutter contre ces phénomènes, tout en restant neutres. Cependant, après la chute des valeurs technologiques en bourse début 2023, ces entreprises ont dû réduire les coûts, affaiblissant les équipes de sécurité électorale. Chez X (anciennement Twitter), les ressources pour la modération ont été drastiquement réduites sous la direction d’Elon Musk, fervent défenseur de la "liberté d'expression absolue".

Parallèlement, la vérification des contenus et la lutte contre la désinformation deviennent des enjeux politiques. La droite accuse les plateformes de censure, tandis que la gauche alerte sur le danger de cette polarisation. En décembre, le gouvernement américain a cessé de partager des informations avec Meta, mettant en péril l'efficacité des mesures de prévention. Les experts craignent que l'usage sophistiqué de l'IA ne crée un scénario catastrophe pour les démocraties.

En 2016, l'élection de Trump aux États-Unis a révélé au grand jour la cyberguerre de la désinformation. L'implication de la Russie dans la diffusion de contenus manipulés a été démontrée. En 2020, plus de 80 pays ont été affectés par des campagnes de désinformation en ligne. L'avènement de l’IA générative, capable de créer des contenus faux mais convaincants, exacerbe le problème. Des plateformes comme Meta et Google introduisent de nouvelles mesures pour contrer cette tendance, mais la lutte reste complexe et dépend largement de la rapidité de réaction des plateformes.

Les experts soulignent que les campagnes de désinformation ciblent en priorité les entreprises à la traîne en matière de modération. La réglementation est cruciale, mais sa mise en œuvre reste un défi majeur. Le projet de loi européen, décrit comme "le plus ambitieux du monde" par Nick Clegg de Meta, pourrait établir un nouveau standard pour évaluer les risques et imposer la transparence. Toutefois, des pays comme la France pourraient retarder le vote en quête de concessions, soulignant la nécessité d'adapter la réglementation à l'évolution rapide de la technologie.